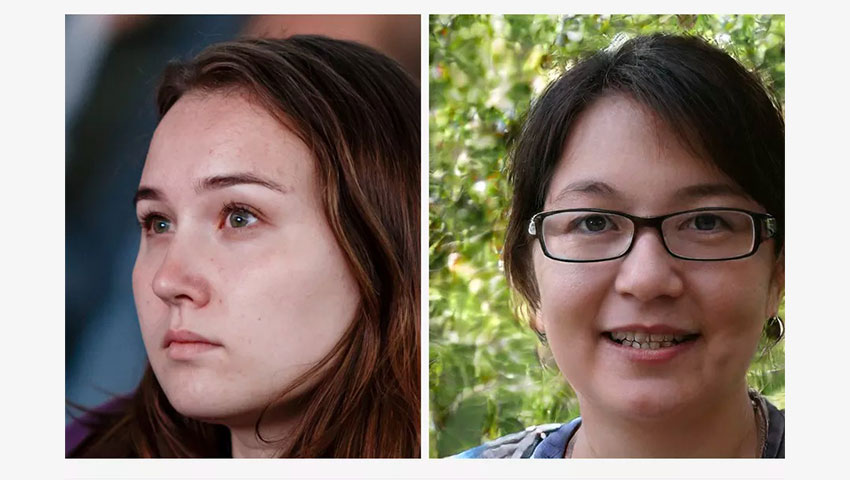

وب سایت ThisPersonDoesNotExist.com از چندی پیش سر و صدای زیادی به پا کرده و توجه مخاطبان زیادی را به خود جلب کرده است. کاری که این سایت انجام میدهد، از نام آن کاملاً مشخص است: ساخت چهرههایی که واقعی نیستند و تنها حاصل به کارگیری فناوری هوش مصنوعی میباشند. اخیراً یک وب سایت دیگر نیز شروع به کار کرده که در واقع ادامه دهنده همین راه بوده و WhichFaceIsReal.com نام دارد. نام این سایت هم گویای کارکرد آن است و نشان میدهد که هدف بازدیدکنندگان به چالش کشیدن تواناییشان در زمینه شناسایی چهرههای واقعی از چهرههای طراحی شده به وسیله هوش مصنوعی است! اگر فکر میکنید هوش مصنوعی نمیتواند شما را فریب دهد، همین حالا میتوانید با مراجعه به سایت مذکور خودتان را امتحان کنید.

البته WhichFaceIsReal.com هدف بالاتری را نیز دنبال میکند. این وب سایت توسط دو تن از اساتید دانشگاه واشینگتن، با نامهای جوین وست و کارل برگستروم بنا نهاده شده که هر دو آنها مشغول مطالعه در زمینه چگونگی گسترش اطلاعات در سطح جامعه هستند. این دو محقق عقیده دارند که افزایش تصاویر و اطلاعات غیر واقعی تولید شده توسط هوش مصنوعی میتواند مشکل ساز بوده و اعتماد افراد جامعه را به شواهد تضعیف کند. لذا میخواهند از طریق این وب سایت و با آموزش مخاطبان، تا حد ممکن از بروز چنین مشکلی جلوگیری کنند.

برگستروم در این باره گفته است:

هنگامی که یک فناوری جدید مانند این (ساخت چهرههای غیر واقعی به وسیله هوش مصنوعی) ظهور میکند، خطرناکترین دوره زمانی، وقتی است که تکنولوژی به کار گرفته شده اما مردم از وجود آن آگاه نیستند. البته در عین حال، این دوره دقیقاً زمانی است که فناوری مذکور بیشترین تأثیر را میتواند داشته باشد.

وست نیز نظر خود را چنین بیان کرده است:

بنابراین آنچه ما تلاش میکنیم انجام دهیم این است که مردم را آموزش دهیم و این آگاهی را به آنها بدهیم که چنین فناوریای در حال حاضر وجود دارد. همان طور که این روزها تقریباً همه افراد جامعه از قابلیتهای فتوشاپ اطلاع دارند و میدانند که همواره امکان دستکاری تصاویر توسط این برنامه وجود دارد.

هر دو سایت اشاره شده، از یک روش یادگیری ماشینی تحت عنوان “generative adversarial network” (شبکه مشارکتی مولد) یا به اختصار GAN، برای تولید عکسهای غیرواقعی استفاده میکنند. چنین شبکههایی با دسترسی به حجم عظیمی از دادهها و کنار هم قرار دادن آنها به اهداف تعیین شده خود میرسند که در اینجا این هدف، استفاده از تصاویر پرتره واقعی برای ساخت نمونههای غیرواقعی است؛ در واقع هوش مصنوعی با یادگیری الگوهای به کار رفته در دادهها، تلاش میکند تا نمونههای جدیدی را بر پایه همین الگوها تولید کند.

یکی از دلایلی که باعث شده نتیجه کار شبکههای GAN عالی به نظر برسد، این است که این شبکهها همواره نتایج خود را مورد تست و ارزیابی قرار میدهند. مثلاٌ یکی از بخشهای شبکه، تصویری از چهره یک انسان را ایجاد میکند و بخش دیگر به مقایسه آن با نمونههای واقعی میپردازد. اگر تفاوت مشهودی یافت شود، تصویر دوباره به بخش اول بازگشت داده میشود تا اصلاحات لازم انجام شده و نتیجه مطلوب حاصل شود. در واقع شیوه عملکرد این شبکهها را میتوان به یک کلاس هنر تشبیه کرد که در آن تا زمانی دانش آموز نتواند انتظارات معلم خود را برآورده کند، هیچ کس از کلاس خارج نمیشود!

چنین تکنیکهایی علاوه بر ساخت تصاویر، میتوانند برای تولید صوت و ویدیو هم به کار گرفته شوند. هر چند که در حال حاضر در این مسیر محدویتهای زیادی وجود دارد، اما فناوری روز به روز در حال پیشرفت است و به مرور زمان نواقص کمتر و کمتر میشوند. یکی از هوش مصنوعیهایی که هم اکنون توانایی خلق ویدیوهایی حیرت انگیز را دارد، Deepfakes است که سر و صدای زیادی هم به پا کرده است.

وست و برگستروم در عین حال اشاره کردهاند که با وجود فناوری خلق چهره به وسیله هوش مصنوعی، امکان سوء استفاده از آن نیز همواره وجود دارد و به عنوان مثال جنایتکاران میتوانند از این فناوری برای ساخت تصویری از چهره یک انسان غیرواقعی استفاده کرده و با انتشار آن در فضای مجازی، یک متهم خیالی را معرفی کرده و توجه رسانهها و مردم را از واقعیت منحرف کنند.

معمولاً روزنامه نگاران و رسانههای دیگر وقتی با تصویری روبرو میشوند که توسط منابع غیر موثق به دستشان رسیده، میتوانند به وسیله ایزارهایی مانند جستجوی تصویر گوگل، منبع اصلی عکس را پیدا کرده و به این ترتیب از صحت و سقم آن اطمینان حاصل کنند. پس اگر کسی بخواهد از تصویری که پیش از این وجود داشته استفاده کند، خیلی زود لو خواهد رفت، اما شرایط در مورد عکسهای تولید شده توسط هوش مصنوعی کاملاً فرق دارد و هیچ کس نمیتواند صحت یا عدم صحت آنها را تأیید کند.

این مشکلی است که وست و برگستروم نیز دقیقاً به آن اشاره داشته و میگویند محققان و افراد دانشگاهی در تلاش هستند تا بتوانند ابزارهایی را برای تشخیص نتایج کار هوش مصنوعی، تولید کنند. بنا به گفته وست، در حال حاضر و در این سطح از فناوری، امکان تشخیص چهرههای واقعی از غیر واقعی به سادگی امکانپذیر است و با گذارندن تستهای ارائه شده در WhichFaceIsReal.com تا حدود زیادی با روش این کار آشنا شد. اساساً در نتایج کار هوش مصنوعی ایرادهایی را میتوان مشاهده کرد که از جمله آنها میتوان به نامتقاون بودن چهره، دندانهای ناهماهنگ، موهای غیر واقعی و فرم نامتعارف گوش، اشاره کرد.

اما مسلماً این تصاویر غیر واقعی روز به روز بهتر خواهند شد، به طوری که وست معتقد است تا سه سال آینده امکان تشخیص آنها به روشهای کنونی میسر نخواهد بود. بنابراین اطلاع و آگاهی داشتن از شرایط بسیار کارساز بوده و میتواند در مقابله با فریب خوردگی انسانها از هوش مصنوعی مؤثر باشد. به قول برگستروم: “ما نمیگوییم مردم هیچ چیز را باور نکنند، بلکه پیام ما این است که زودباور نباشید.”